こんにちわ、AICU mediaの くしろです。

突然ですが、読者の皆さんはゲームを遊ぶときにどんなコントローラを使っていますか?

ゲーム専用機ではなくてPCでゲームをしてる場合はキーボードやマウスを使う人もいると思いますが、多分ほとんどの人がゲームパッドでプレイしているんじゃないでしょうか。

ゲームパッドには方向キー・ボタン・アナログスティックなどが付いていて、ありとあらゆるジャンルのゲームに対応することが出来るとても便利なコントローラです。

でも汎用性が高いということは専門性はそれほど高くないということと表裏一体の関係にあると言えます。

昔のゲーム業界はプレイヤーによりゲームに没入してもらうためにジャンルに合わせた専用コントローラを開発して臨場感を高めようとしていました。

その一つが一人称シューティングゲーム、いわゆるFPS(First-person shooter))用の銃の形をしたガンコントローラ(以下、ガンコン)です。

今回の東京ゲームショウ2024でこのガンコンにAI技術を応用した製品が展示されていたので紹介します。

ガンコンの仕組み

その前にガンコンの仕組みと歴史について説明させてください。

これをしておかないと今回のコントローラの新規性がピンとこないと思うので少々お付き合いをお願いします。

ブラウン管対応光センサータイプ

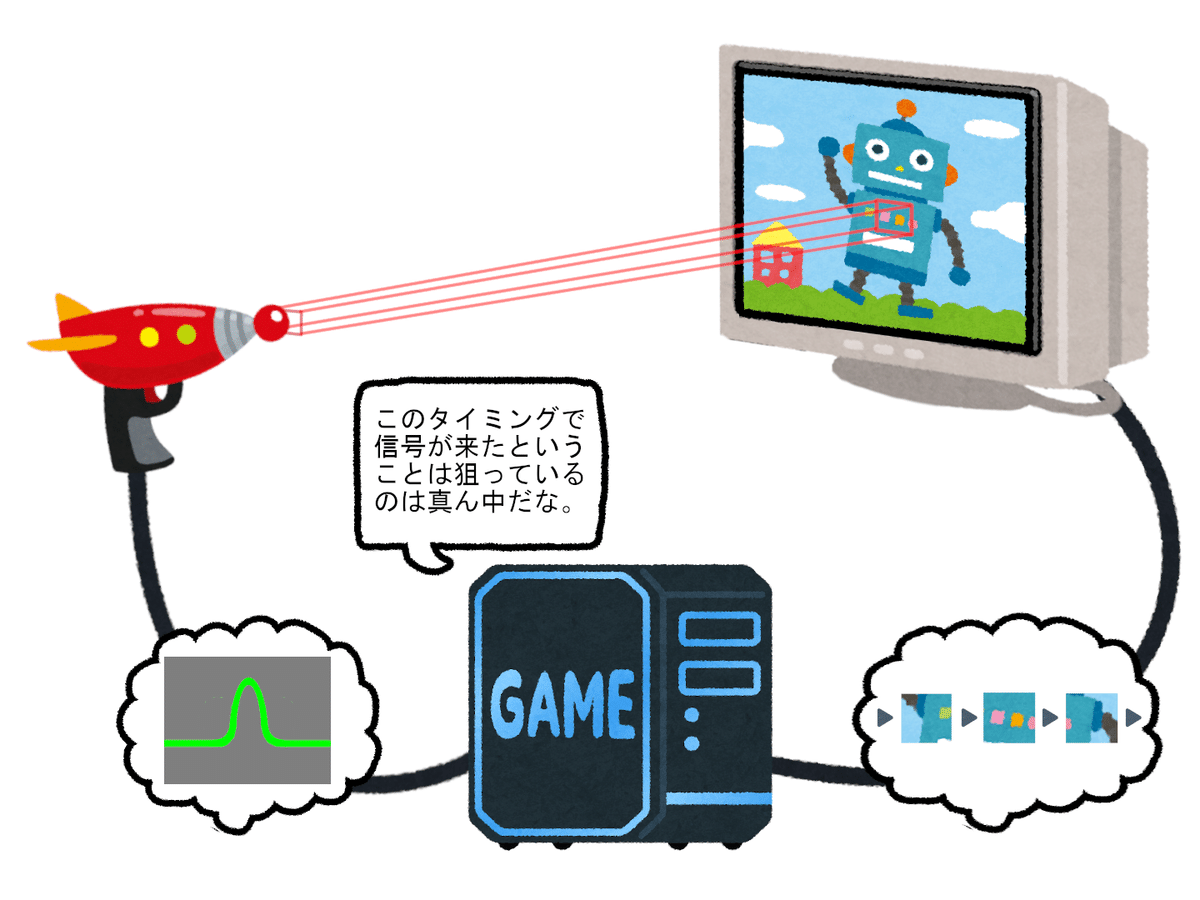

まず、下のイラストをご覧ください。これは昔のブラウン管ディスプレイに対応したガンコンの概念図です。

ゲーム機で生成された1フレーム分の画像は1行ずつのアナログ信号に変換されて出力ケーブルを通してディスプレイに送られます。

ブラウン管ディスプレイ内部ではその信号を画面の左上から右に向かって電子銃で電子をぶつけ、蛍光体を光らせます。これが1行分の表示です。電子ビームが端まで辿り着いたら折り返して1ピクセル下からまた右へを繰り返し、右下まで描画したらまた左上に戻って次の画像の表示を開始します。

ここでポイントになるのは、描画スタートからの経過時間とディスプレイ画面上の描画位置は一対一の関係にあるということで、ガンコンはこれを利用して画面上の位置をセンシングしています。

具体的には、ガンコンの銃身の奥に光に反応して信号を出すセンサーが取り付けられていて、センサーにディスプレイの光が差し込むとゲーム機に信号を送ります。

ゲーム機は描画スタート(同期信号)からどのくらい時間が経ってから信号が来たかでガンコンが指し示した画面上の位置を把握するのです。

この手法のメリットはシンプルな回路で実装でき、ローコストなこと。

ただし、弱点もあります。それは、暗い画面やには反応しないことです。

光に反応するセンサーを使っているのですから当たり前のことなのですが、だからと言って暗い所が無いビジュアルのゲームという縛りで開発を行うというのも無理があります。

そこで考え出されたのが、引き金を引いた時に一瞬だけ画面全体を均一な明るさにしてセンシングし易くするという手法でファミコンの「ダックハント」などで実装されています。

これはとても有効なのですが、光の明滅はプレイヤーの目を疲れさせるので、長時間のプレイは厳しいかもしれません。

薄型ディスプレイ対応マーカータイプ

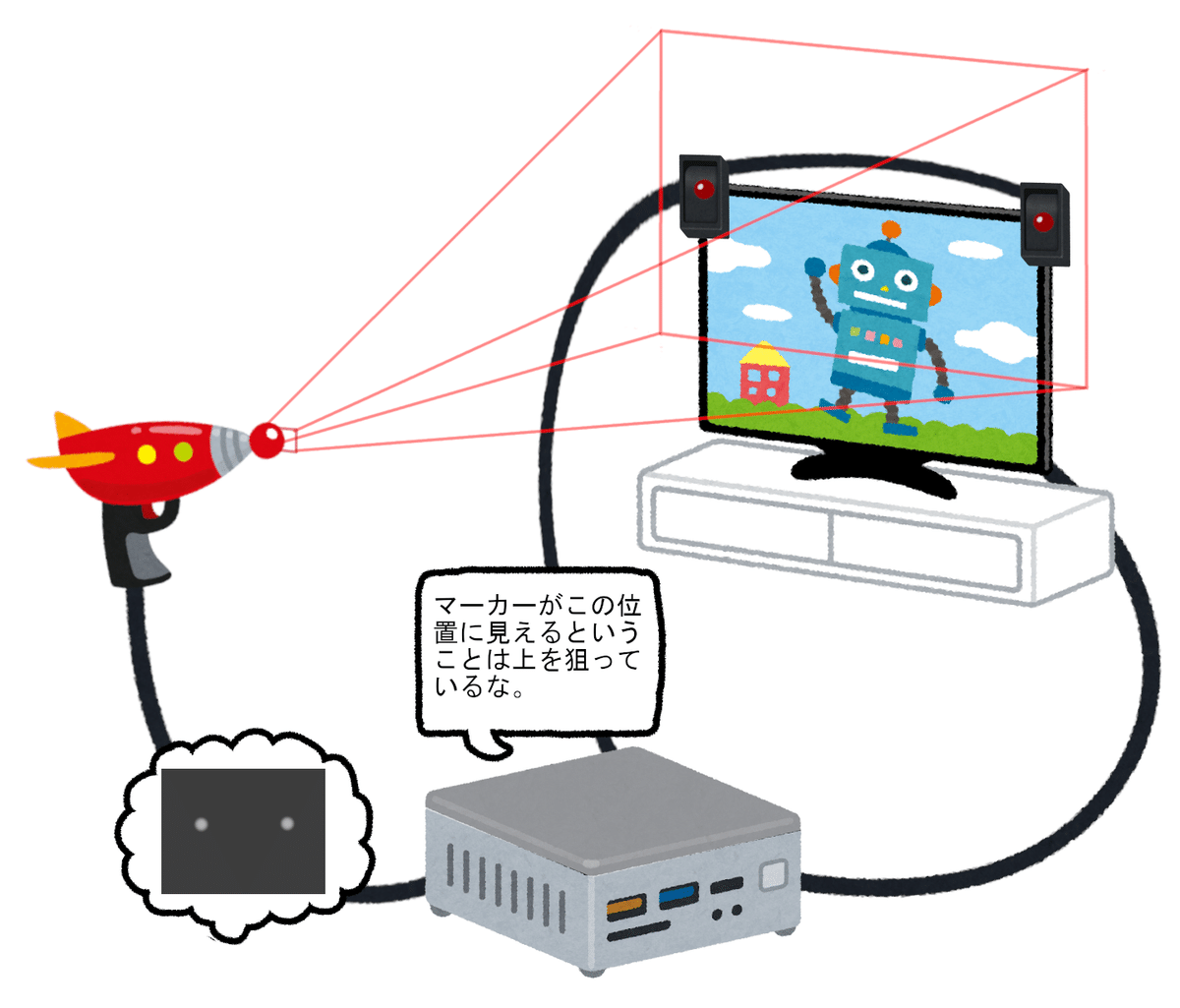

次に登場したのが、赤外線カメラを搭載したガンコンと赤外線LEDマーカーとを組み合わせた手法です。

これはディスプレイの主流が液晶やプラズマなどのブラウン管とは違う表示方式に移行したことで今までの手法が使えなくなったことへの対応です。

下のイラストにその概念を示します。

まず、赤外線LEDマーカーを所定の位置(この場合はディスプレイの上辺の左右両端)に設置します。

そして、このマーカーから発せられる赤外線をガンコンの銃口にある赤外線カメラが読み取ってゲーム機に送り、マーカーの見え方からディスプレイのどこを狙っているのかを把握します。

任天堂Wiiなどが代表的です。

この方式の良いところは、前述の光センサーを使用したガンコンで必須だった撃つたびに画面を均一な明るさにする必要がないことです。

でも、この手法では別の問題を新たに抱えることになりました。

それは、赤外線LEDマーカーを適切な位置に設置しないと正しく動作しないということです。

例えば、左右のマーカーの高さや向き、傾きが合っていないと誤動作してしまいます。

それに家庭用ディスプレイには色んなサイズやデザインの製品があるのでマーカーを設置する環境をプレイヤーごとに変わって一定にはなりません。

ですから、マーカーを事前に想定された設置状態に近づけるための調整がとても重要になります。

特に大画面テレビが一般的になっていると、それをカバーできるLEDマーカーをつくることはハードウェアのコストや「設置の煩雑さがあって遊んでもらえない」という潜在的問題もあるのかもしれません。

AI技術を使用した新世代のガンコン

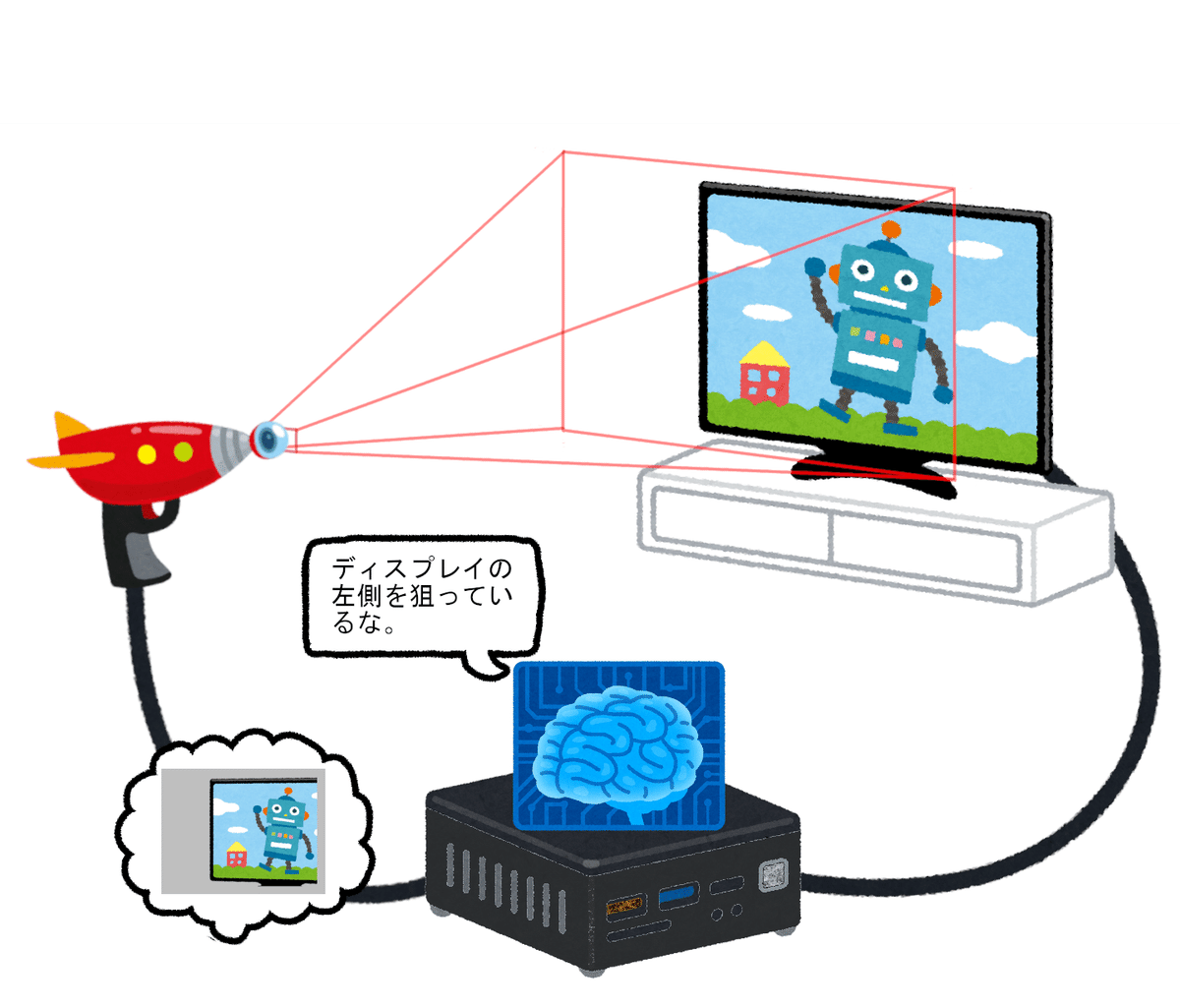

今回紹介する達成電器の「G’AIM’E」は今までのガンコンの問題点をAIで克服した画期的な製品です。

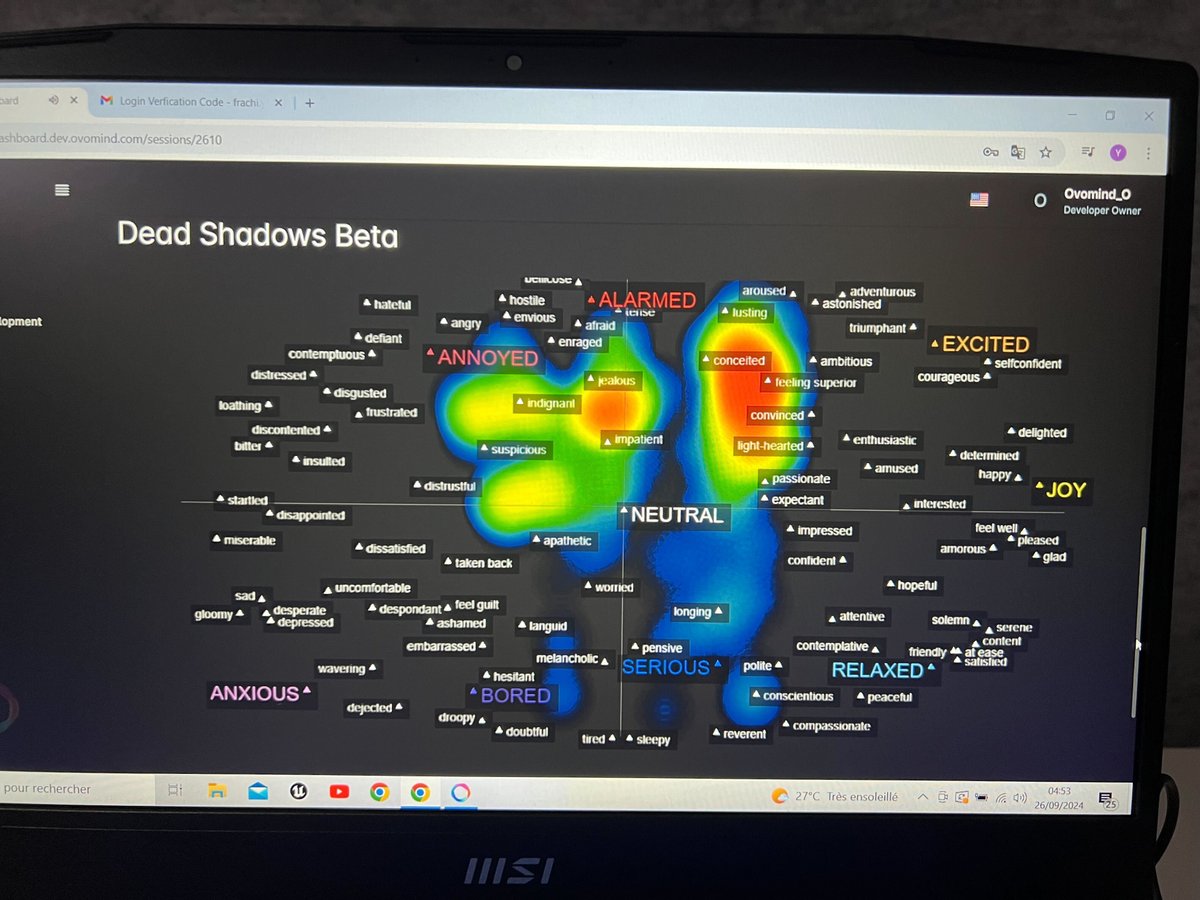

具体的には、ガンコンの銃口にあるカメラで取得した画像からAIがディスプレイを認識してガンコンの位置や向きを把握するという仕組みです。

ちなみに奥に見える黒いボックス状のものが本体になります。

イラストや風に描き起こした概念図も置いておきます。

これまでに紹介した手法はガンコンが指し示すディスプレイ上の位置を間接的に把握するというもので、それによるデメリットは前述した通りです。

それに対し「G’AIM’E」は人間と同じ様に直接的にディスプレイを認識している点が非常に画期的です。

開発の方にお伺いしたところ、「ガンシューティングゲームはブラウン管の時代に人気のあるジャンルでしたが、液晶の時代になってあまり普及しなくなりました。そこで最新技術を使って気軽に遊べるプラグ&プレイの形で提供すれば愉しんでもらえるのではないかと考えて開発しました。」とのことでした。

また、AI技術としては機械学習を使用したそうで、素材としては、まず24インチから30インチまでのモニターと45インチから100インチまでのテレビといった多種多様なディスプレイを用意して、正面や上下左右の斜めからディスプレイを撮影した画像を大量に使用して学習させたとのことでした。

アーケードゲームの名作「タイムクライシス」が再び!

今回のTGS2024で展示されていたデモは、1995年にナムコ(現バンダイナムコ)がゲームセンター用に開発したガンシューティングゲームの「タイムクライシス」のライセンス版が遊べる本体とガンコンとペダルという構成で、本体をディスプレイに接続するだけでの手間いらずで直ぐにプレイすることができます。

なお、「タイムクライシス」は、障害物の陰に隠れて敵の攻撃をかわしながら自分が攻撃する時はペダルを踏んで敵に姿を見せて撃ち合うというプレイスタイルのゲームです。

私はこのゲームをゲームセンターで遊んだことがあるのですが、実際にプレイしてみて特に違和感を抱くことも無く、逆に当時の楽しかった記憶が蘇ってきて非常に良く出来ているなと感心しました。

実はこの製品は2025年9月発売を目指し鋭意開発中なんだそうです。

そして、現在の一番の課題は遅延の軽減で、現状で25msくらいあるラグタイムを最終的には12msから13ms程度に抑えることが目標だそうです。

遊んでいる時にガンコンの動きとディスプレイ上の照準とのズレは特に感じなかったのですが、もしかしたらガンコンを振り回す様な早い動きをすると問題が出てくるのかもしれません。

この課題をどうやって解決するのかついては具体的なお話は伺えなかったのですが、ディスプレイの認識精度を高く維持したままの画像の認識スピードを向上させるAIの開発は難しい挑戦になるのではないかと想像します。

是非、頑張って解決することを期待してます。

まとめ

以上、「つくる人をつくる」をビジョンとするAICUにジョインをした くしろがお伝えしました。

もしかしたら来年の今ごろはこの製品が発売されているかもしれませんし、恐らく東京ゲームショウ2025の達成電器のブースにはバージョンアップされた「G’AIM’E」が展示されると思いますので、興味ある読者の皆さまは是非遊んでみてください。

私も楽しみに待ちたいと思います。

AICUでは今後も読者の皆様にむけて、ディープなイベント取材を実施していきたいと思います!

この記事に「いいね!」と思ったら、いいねとフォロー、おすすめをお願いします!

https://note.com/aicu/ X(Twitter)@AICUai

#TimeCrisis #TGS2024 #タイムクライシス #ガンコン #達成電器 #エンタメxAI

Originally published at https://note.com on Oct 3, 2024.