日本時間2024年6月12日午後10時ごろ、ついに Stable Diffusion 3のオープンな最新モデル「Stable Diffusion 3 Medium」のweightsがリリースされました。公式リリースを中心にお送りします。

Stability AI が Stable Diffusion 3 の weights を 2024年6月12日に公開予定…ところで画像生成AIにおける weights って何?

最も洗練された画像生成モデル、Stable Diffusion 3 Medium のオープンリリースを発表 — Stability AI Japan

最も洗練された画像生成モデル、Stable Diffusion 3 Medium のオープンリリースを発表

- Stable Diffusion 3 Medium は、Stability AI の最も先進的なテキストから画像を生成するオープンモデルで、20億のパラメータから構成されています。

- このモデルはサイズが小さいため、個人向けシステムや企業向けGPUで動作させるのに最適です。

- このモデルは、現在、オープンな非商用ライセンスと低コストのクリエイターライセンスの下で利用可能です。大規模な商用利用のライセンスの詳細についてお問い合わせください。

- このモデルを手軽に利用するには、 Stability Platform のAPI を利用するか、Stable Assistant や、 Discord 上の Stable Artisan からもご利用いただけます。

Stable Diffusion 3 シリーズの最新かつ最も高度なテキストから画像へのAIモデルである Stable Diffusion 3 Medium を発表できることを嬉しく思います。Stable Diffusion 3 Medium は、生成AIの進化における重要なマイルストーンであり、このパワフルなテクノロジーを民主化するというStability AI のコミットメントを継続するものです。

SD3 Medium の特徴

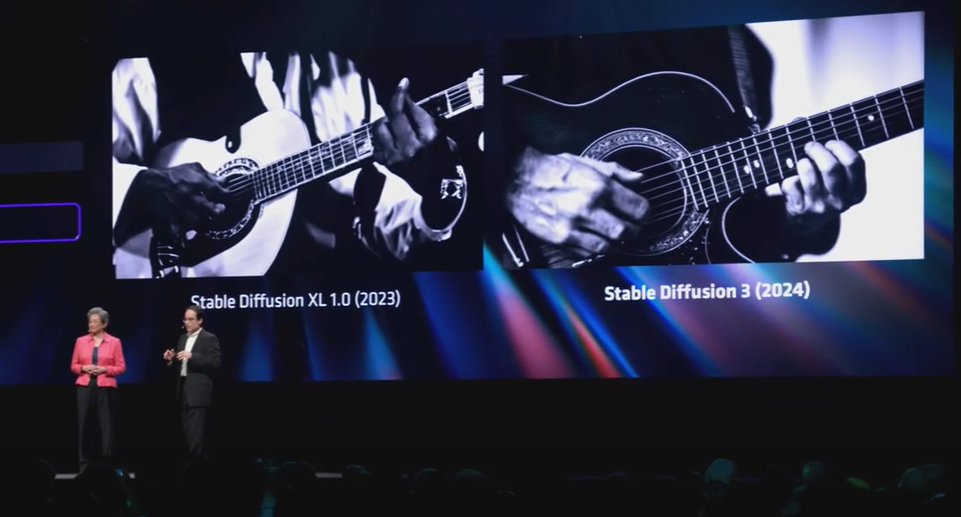

SD3 Medium は、SD3の20億パラメーターモデルで、いくつかの特筆すべき特徴を備えています。

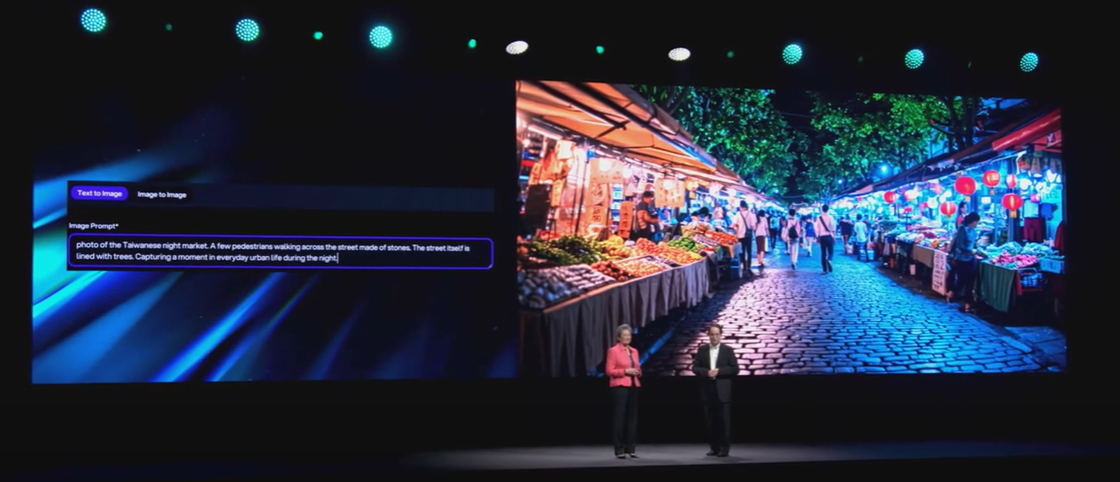

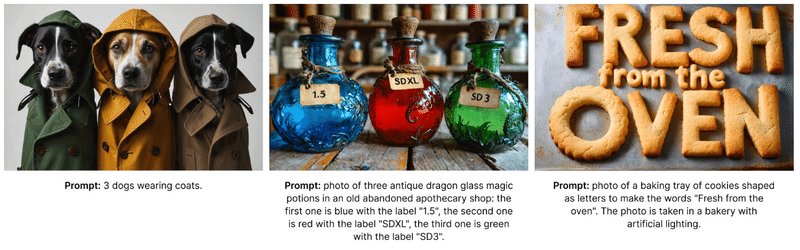

- フォトリアリズム: 手や顔によく見られる不自然さを克服し、複雑なワークフローを必要とせずに高品質の画像を提供します。

- プロンプトの忠実さ: 空間的関係、構成要素、動作、スタイルを含む複雑なプロンプトを理解します。

- テキスト生成: Diffusion Transformer architecture により、ノイズやスペルミスのないテキスト生成において、これまでにない結果を達成します。

- リソース効率: 低いVRAMフットプリントにより、標準的なコンシューマー向けGPUでパフォーマンスを低下させることなく実行することができます。

- ファインチューニング: 小さなデータセットから微妙なディテールを理解することができ、カスタマイズに最適です。

NVIDIA とのコラボレーション

NVIDIAとコラボレーションし、NVIDIA® RTX™ GPUとTensorRT™を活用することで、Stable Diffusion 3 Medium を含むすべてのStable Diffusion モデルのパフォーマンスを強化しました。TensorRT で最適化されたバージョンは、クラス最高のパフォーマンスを提供し、パフォーマンスが50%向上します。

TensorRT に最適化された Stable Diffusion 3 Medium にご期待ください。

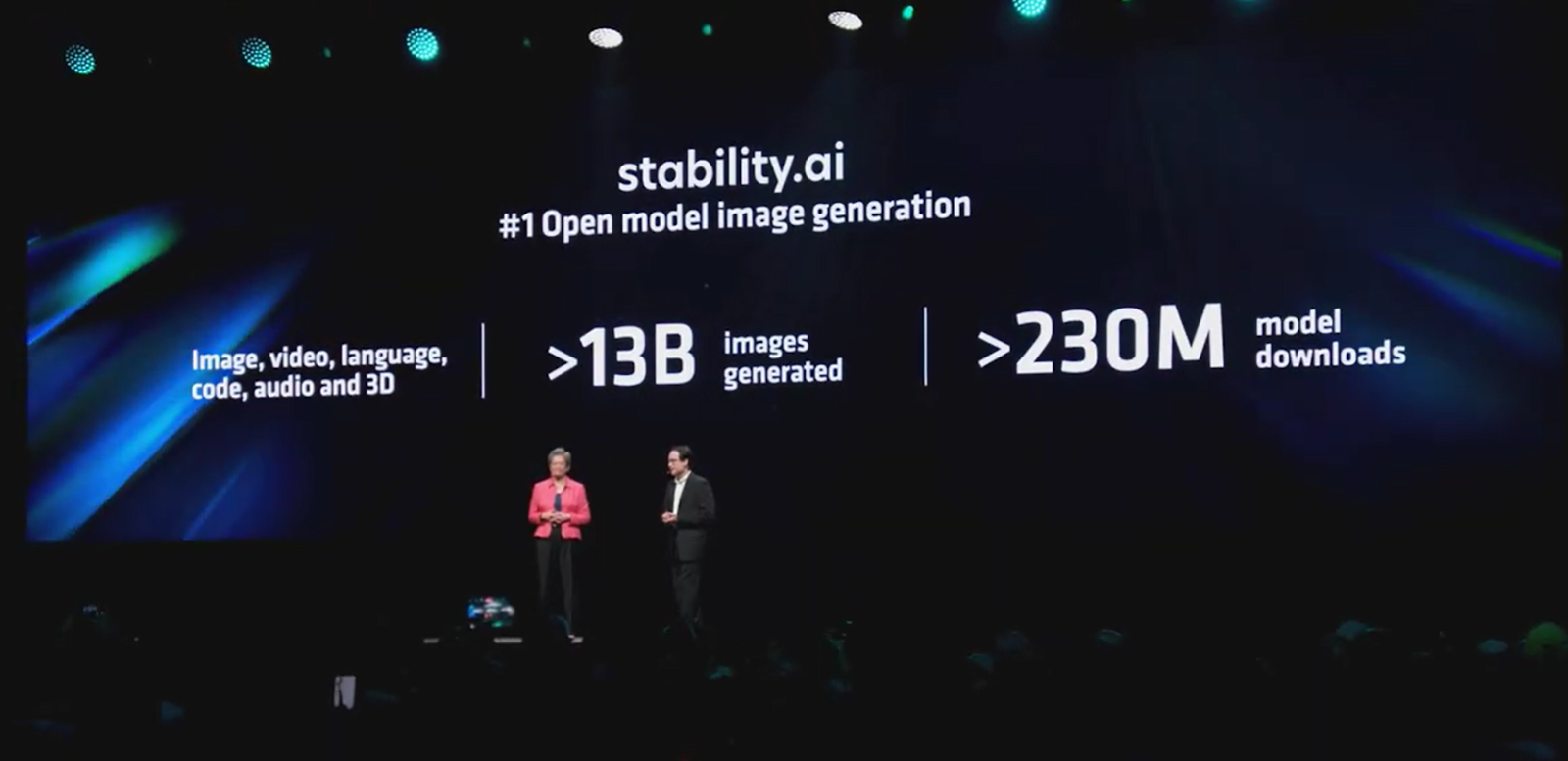

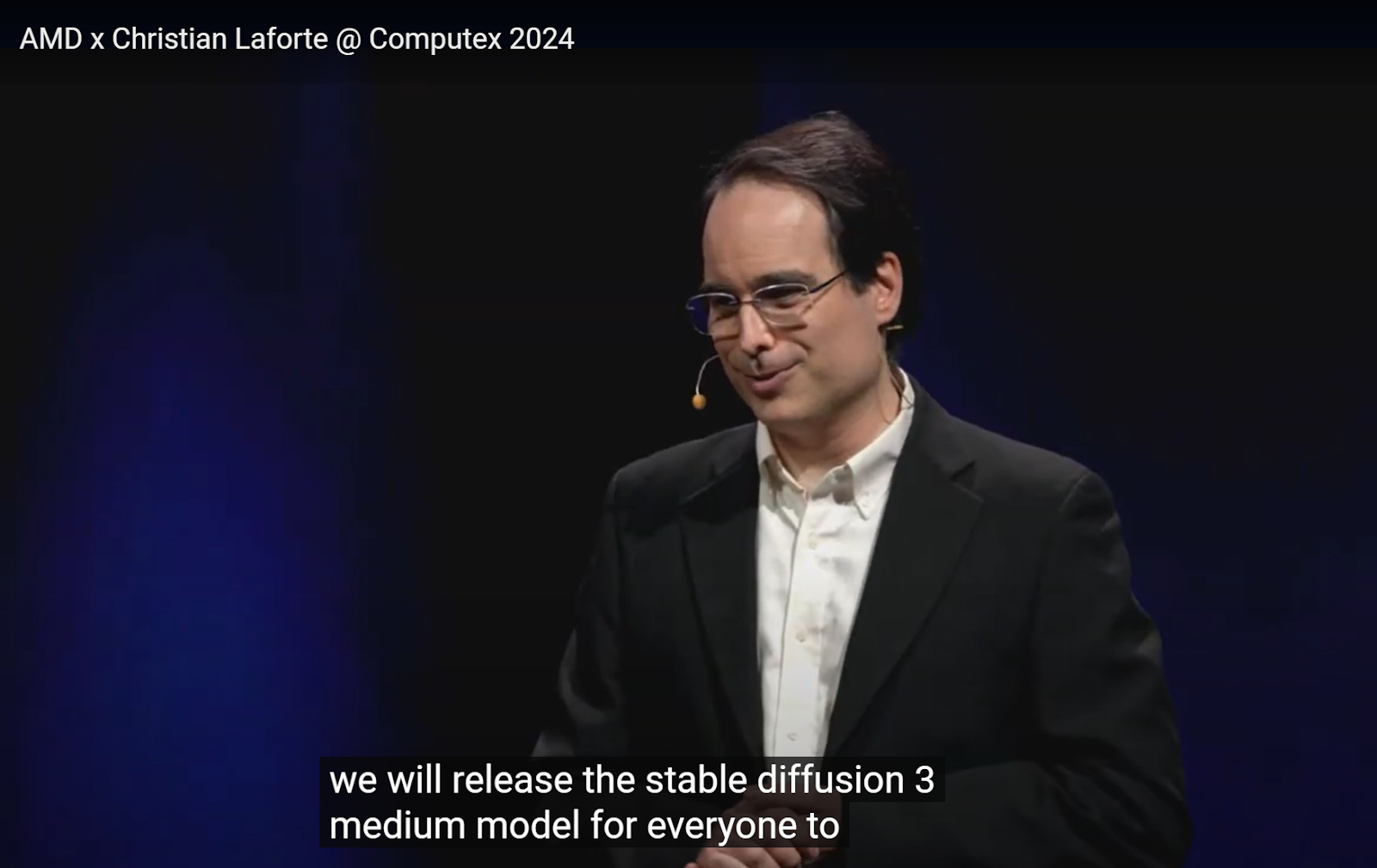

AMD とのコラボレーション

最新のAPU、コンシューマー向けGPU、MI-300XエンタープライズGPUなど、さまざまなAMDデバイス向けにSD3 Medium の推論を最適化しています。

オープンでアクセスしやすいモデル

オープンな生成AIへの Stability AI のコミットメントは揺るぎません。Stable Diffusion 3 Medium は無償の非商用ライセンスでリリースされ、Hugging Face を通じて入手可能です。アーティスト、デザイナー、開発者、AI愛好家の皆さまは新しいクリエイターライセンスをご利用ください。

大規模な商用利用については、お問い合わせください。

⭐︎AICUはStability AIの公式パートナーです sai@aicu.ai ⭐︎

HuggingFaceのモデルカードで詳細情報が公開されています

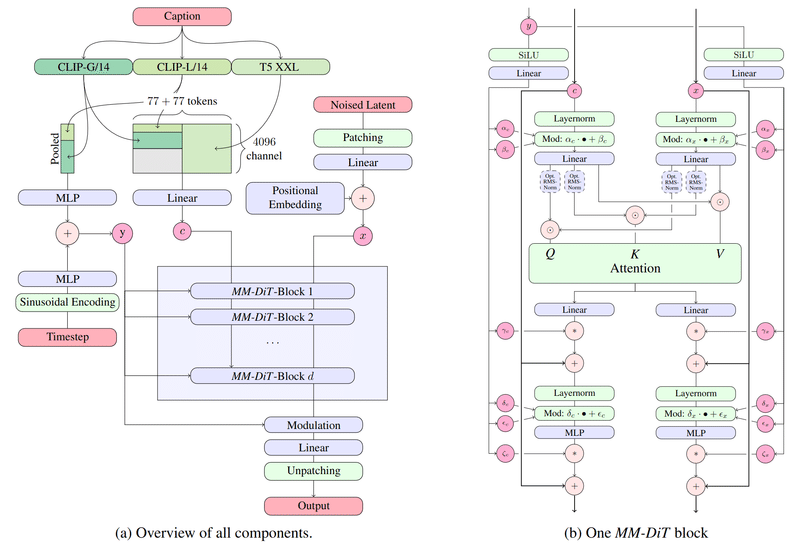

モデルの種類: MMDiTテキスト画像生成モデル

モデルの説明: テキストプロンプトに基づいて画像を生成するために使用できるモデルです。マルチモーダル拡散変換器(Multimodal Diffusion Transformer)(https://arxiv.org/abs/2403.03206)であり、3つの固定された事前学習済みテキストエンコーダ(OpenCLIP-ViT/G、CLIP-ViT/L、T5-xxl)を使用します。

APIとアプリケーションでStable Diffusion 3を試してみる

オープンリリースと同時に、Stable Diffusion 3 Medium を API でご利用いただけるようになりました。Stable Diffusion 3 のモデルをベースにした様々な強力な画像サービスが、Stable Assistant や、Stable Artisan 経由の Discord でお試しいただけます。まずは3日間の無料トライアルをお試しください。

利用方法

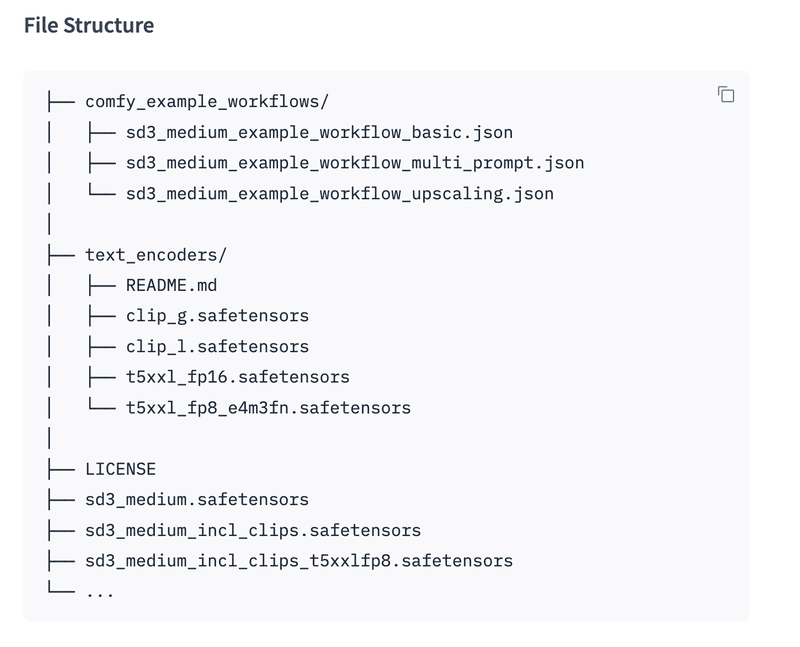

- Stable Diffusion 3 Medium を ダウンロード: 非商用利用目的で Hugging Face からダウンロードする。

- 商用利用: Contact us からお問い合わせください。

- アプリケーション: Stable Assistant と Stable Artisan からもご利用いただけます。

- FAQ: その他は FAQs をご確認ください。

安全性

Stability AI は、安全で責任あるAIの実践を信じています。これは、悪意ある者による Stable Diffusion 3 Medium の悪用を防ぐために、合理的な手段を講じ、それを継続することを意味します。安全性は、モデルのトレーニングを開始した時点から始まり、テスト、評価、デプロイを通して継続します。Stability AI は、このモデルの広範な内部および外部テストを実施し、危害を防止するための数多くのセーフガードを開発し、実施してきました。

研究者、専門家、そしてコミュニティと継続的に協力することで、モデルを改善し続けながら、誠実にさらなる革新を進めていきます。Stability AI の安全性へのアプローチについての詳細は、 Stable Safety をご参照ください。

ライセンス

Stable Diffusion 3 Mediumは、Stability Non-Commercial Research Community Licenseの下でリリースされています。

Stability AI は、コミュニティが Stable Diffusion 3 を活用することを奨励すると同時に、AIをオープンでアクセス可能な状態に保つというミッションのもと、新しいクリエーターランセンスを導入しました。プロのアーティスト、デザイナー、開発者、AI愛好家の皆様には、クリエーターライセンスを利用して、Stable Diffusion を使った開発を始めることをおすすめします。

大規模な商用ユーザーや企業の方は、ご連絡いただき、エンタープライズライセンスを取得してください。これにより、Stability AI の利用ガイドラインを遵守しながら、皆さまがモデルの可能性を最大限に活用できるようになります。

Stability AIより:今後の展開

皆さまからのフィードバックに基づき、Stable Diffusion 3 Medium を継続的に改善し、機能を拡張し、パフォーマンスを向上させる予定です。Stability AI の目標は、AI生成アートにおける創造性の新たな基準を設定し、Stable Diffusion 3 Medium をプロと趣味利用の方の双方に不可欠なツールにすることです。

皆さんが新しいモデルを使ってどのような作品を創作されるかを楽しみにしていますし、皆さんからのフィードバックを楽しみにしています。共に、生成AIの未来を形作って行けたらと思っています。

公式ツイート動画より