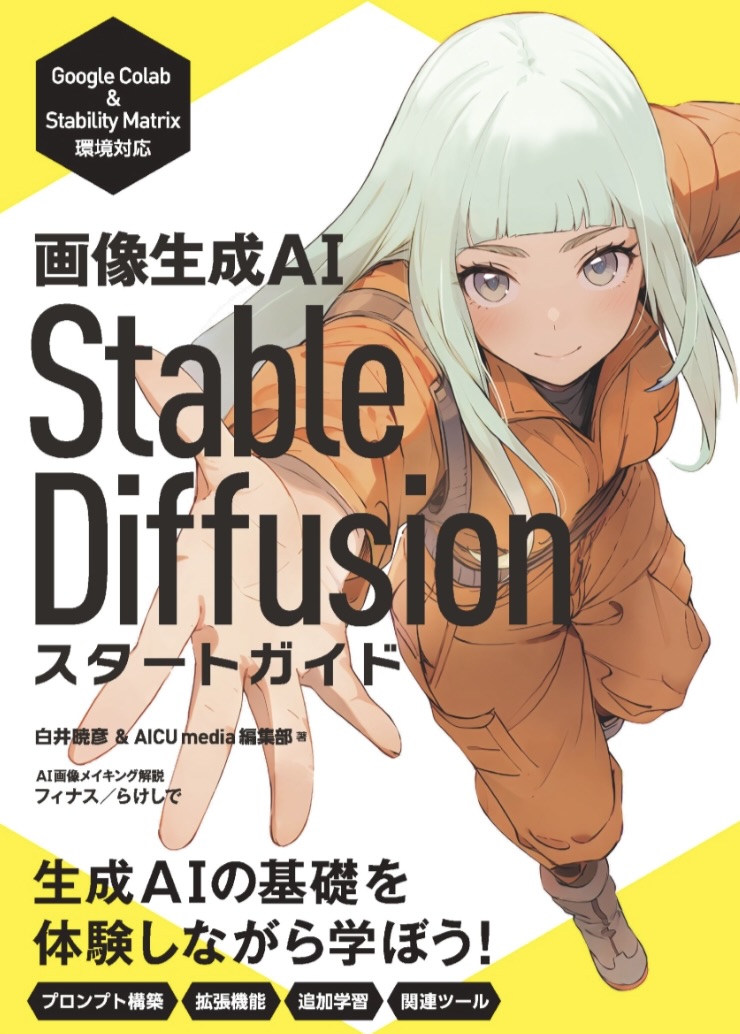

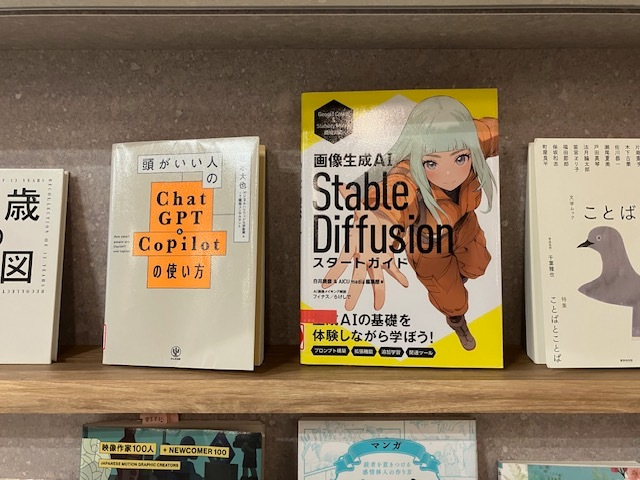

本ワークショップは2024年3月29日に発売された書籍「画像生成AI Stable Diffusion スタートガイド」(白井暁彦+AICU media編集部/SBクリエイティブ刊)をベースに、最新の画像生成AIについて学びたい方のためのワークショップです。

お申し込みはTechplayから https://techplay.jp/event/946209

「生成AIを使うにあたって何に気を付ければいいんだろう?」

「画像生成AIで生成してみたけどこれって著作権違反にならないの?」

「生成AIのモデルを作ってみたいけど何かしなければいけないことはあるのかな?」

このような方に向けて、本書の法律監修で参加された 柴山吉報 弁護士 (阿部井窪片山法律事務所)の とAICU media編集部が、生成AIを取り巻く法律と発注や受注する際に必要な知識、トラブルにならないためのポイントを解説します。

業務の上での発注者や受注者、イベントやスクール開催、教育、著作権や意匠権といった知的財産権との関係、訴訟リスクが高いパターンなど、生成AI・画像生成AIを扱う際の「『陽のあたる場所』を増やすべく、不安な点を明らかにしていく」という目的の公式ワークショップになります。

第1パートはSD黄色本の監修を行った弁護士による勉強会、

第2パートは参加者からの質問にお答えしていく相談会、

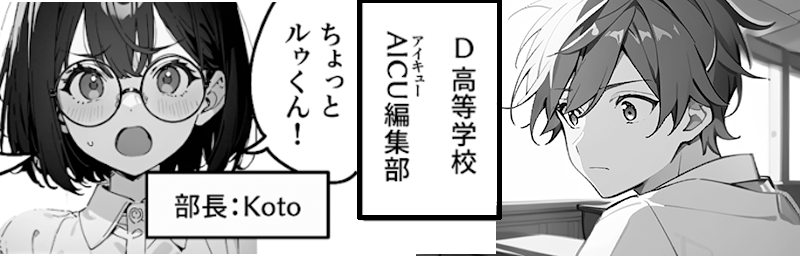

第3パートはAICU編集部とのオンライン交流会・LT登壇を受け付けます。

参加対象

- 生成AIに関するビジネス開発、法務担当者、経営者

- 生成AI時代のクリエイター/フリーランサー

- 広告・映像業界、アニメ制作、ゲーム開発、教育・研究系のプロフェッショナル

- 生成AIを業務や社内で活かしたい方

- これから本書を買ってみようと思う人

- 生成AIを今後の人生に活かしたい方

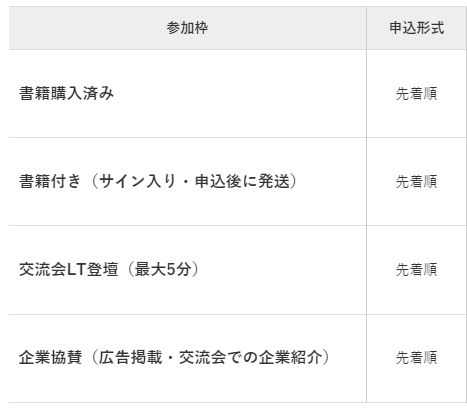

参加費

・書籍購入済みの方 : 2,000円

・書籍付き : 5,000円

・本ワークショップの社内での展開等はこちらをご参考ください

オンラインサイン本企画

申込時に「書籍付き(サイン入り・申込後に発送)」をお選びいただくと、著者の直筆サイン本を事前発送いたします。発送が間に合うように、ぜひとも早めのご参加登録をおすすめします。

タイムスケジュール

| 時間 | 内容 |

|---|---|

| 19:00〜 | オープニング |

| 19:10〜19:30 | 【勉強会】SD黄色本監修弁護士による「生成AIの社会と倫理」 最新の基本知識を解説(仮) |

| 19:30〜20:00 | 【相談会】参加登録者からの事前質問への回答タイム(仮) |

| 20:00〜20:30 | 【交流会】AICU mediaオンライン交流会・ライトニングトーク |

※ 当日予告なく時間配分・内容が変更になる可能性がございます。

登壇者

柴山吉報 弁護士

阿部井窪片山法律事務所 (#SD黄色本 法律監修)

主な取扱分野は、一般企業法務、人事労務、ベンチャー法務、事業再生、M&A等の各分野。IT企業のクライアントが多く、システム開発、AIのモデル開発及びデータの取引等の相談及び契約書の作成、知的財産戦略等に関するアドバイスなどを行う。機械学習エンジニアの資格(JDLA Deep Learning for ENGINEER 2020 #1)を有し、AIエンジニアとしての知見を用いて踏み込んだアドバイスを提供している。 先端的な事業を行うベンチャー企業からの規制法対応や上場支援等の相談を受ける一方で、窮境にある会社の事業計画の策定支援や金融機関との交渉等の事業再生分野の業務も行うなど、様々なフェーズの会社において、事業に深く関与した法的サポートを得意とする。また、事業再生のための組織再編など、多数のM&Aの経験を有する。 特許庁・経済産業省「オープンイノベーション促進のためのモデル契約書ver2.0(AI編)」検討メンバー一般社団法人日本ディープラーニング協会有識者会員AI プロダクト品質保証コンソーシアムメンバー一般社団法人日本ディープラーニング協会の研究会「AIデータと個人情報保護」副座長 主要著書「マンガでわかる DX」(共著)SBクリエイティブ(2023年)「ディープラーニングG検定(ジェネラリスト) 法律・倫理テキスト」(共著)技術評論社(2023年)「実践 ゼロから法務!―立ち上げから組織づくりまで―」(共著) 中央経済社(2023年)「Q&A AIの法務と倫理」(共著) 中央経済社(2021年)「経験者が語るQ&A 電子契約導入・運用実務のすべて」(共同編著) 中央経済社 (2021年)「契約解消の法律実務」(共著)中央経済社(2022年)「第4次産業革命と法律実務-クラウド・IoT・ビッグデータ・AIに関する論点と保護対策-」(共著) 民事法研究会 (2019年)ほか。

白井暁彦

AICU Inc. CEO

白井暁彦(Akihiko Shirai, PhD / しらいはかせ)(X アカウント:@o_ob)エンタメ・メタバース技術の研究開発に関わる研究者、ホワイトハッカー作家、米国スタートアップ「AICU Inc.」「Hidden Pixel Technology Inc.」のCEO。東京工芸大学写真工学科卒、同画像工学専攻修了。キヤノン株式会社とグループの研究所より生まれた英国・Criterion Software にて世界初の産業用ゲームエンジン「RenderWare」の普及開発に参加、その後、東京工業大学知能システム科学専攻に復学。博士学位後、NHK エンジニアリングサービス・次世代コンテント研究室、フランスに渡りENSAM 客員研究員、国際公募展Laval Virtual ReVolution の立ち上げ、日本科学未来館科学コミュニケーター神奈川工科大学情報メディア学科准教授を経て、2018 年よりデジタルハリウッド大学 大学院客員教授 およびグリー株式会社GREE VR Studio Laboratory Director。スマートフォン向けメタバース「REALITY」を開発・運用するREALITY 株式会社の立ち上げを通して、Virtual YouTuber などXR ライブエンタメ技術のR&D、国際発信など、メタバースエンタテイメントの未来開発や知財創出を中心に、自らエンタテイメントのライブプレイヤーとして世界に向けた開発・発信活動方法論化しながら世界中のエンタテインメント技術業界に数百人の規模でクリエイターを育成している。2023 年よりデジタルハリウッド大学発米国スタートアップ企業「AICU Inc.」CEO。生成AI 時代に「つくる人をつくる」をビジョンに英語、日本語、フランス語、プログラミング言語などでオープンな作家活動を続けている。日本バーチャルリアリティ学会 IVRC実行委員会委員。芸術科学会副会長。著書に『画像生成AI Stable Diffusionスタートガイド』、『WiiRemote プログラミング』(オーム社)、『白井博士の未来のゲームデザイン - エンターテインメントシステムの科学-』(ワークスコーポレーション)、『AI とコラボして神絵師になる 論文から読み解くStable Diffusion』(インプレスR&D)他。

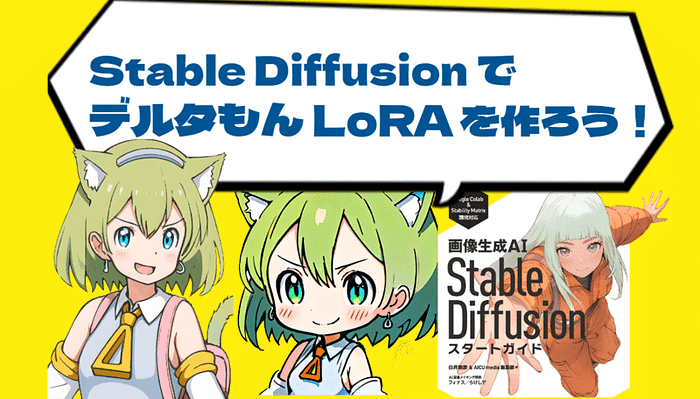

【#SD黄色本 『画像生成AI Stable Diffusion スタートガイド』 紹介】

全目次公開記事はこちら!

https://ja.aicu.ai/sbxl/

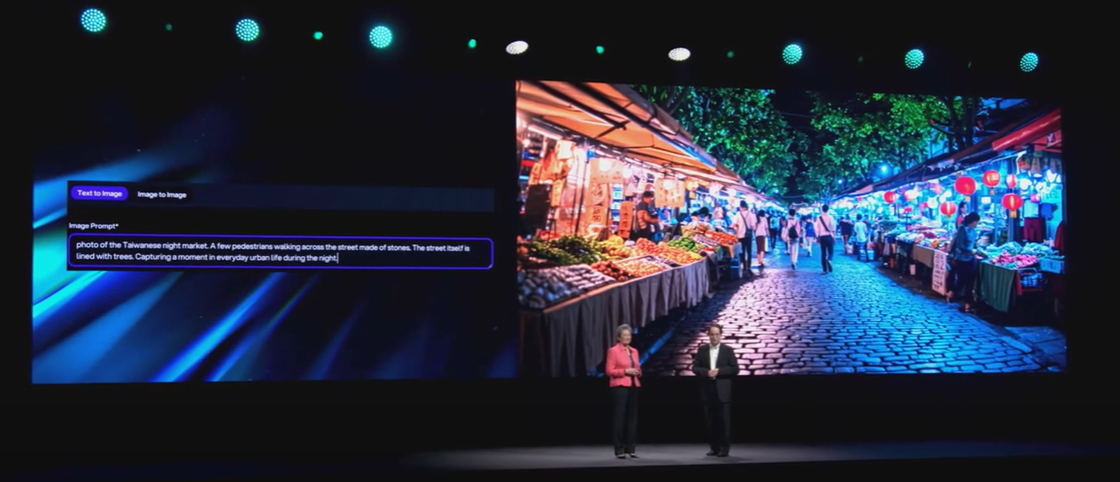

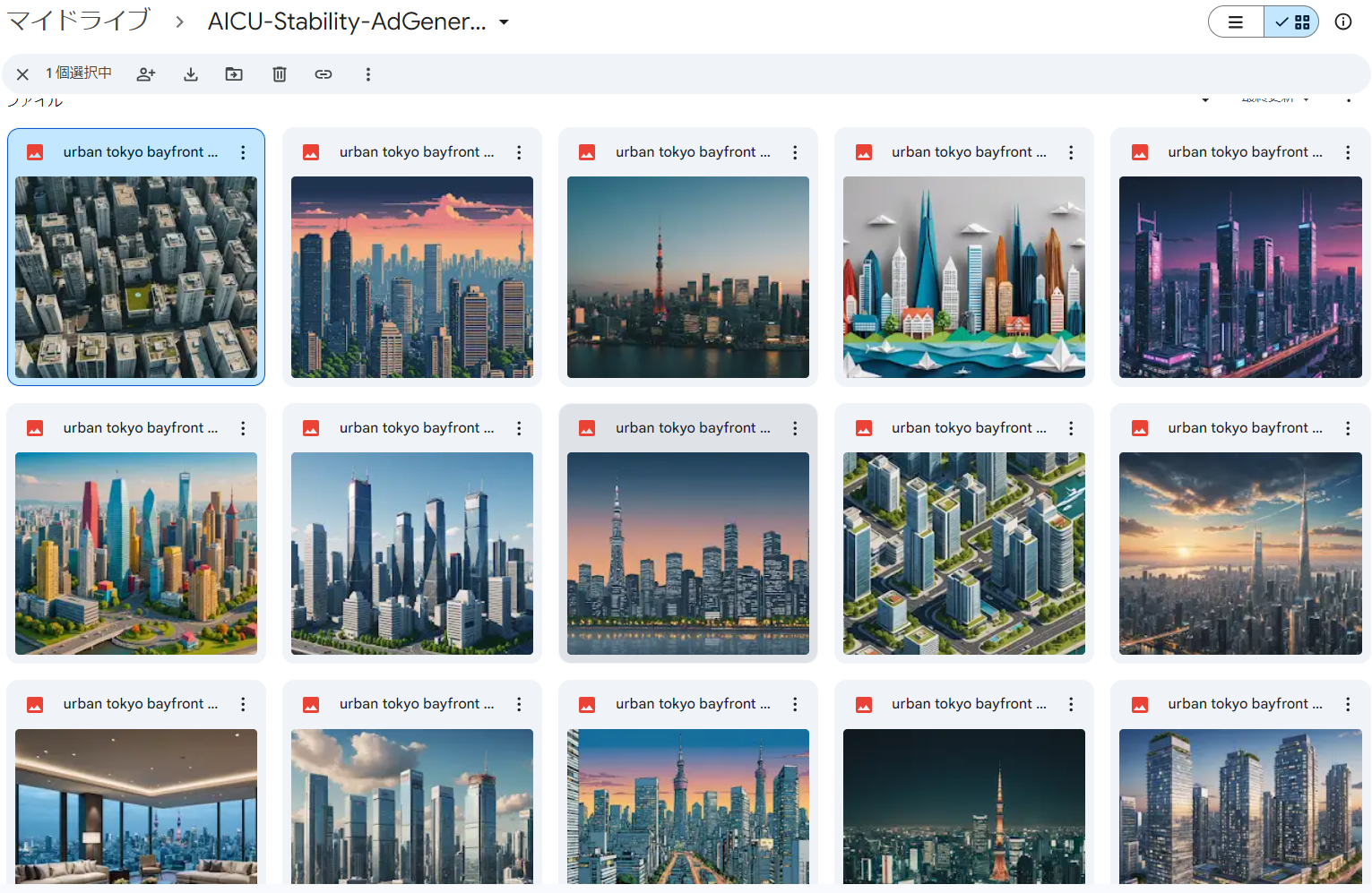

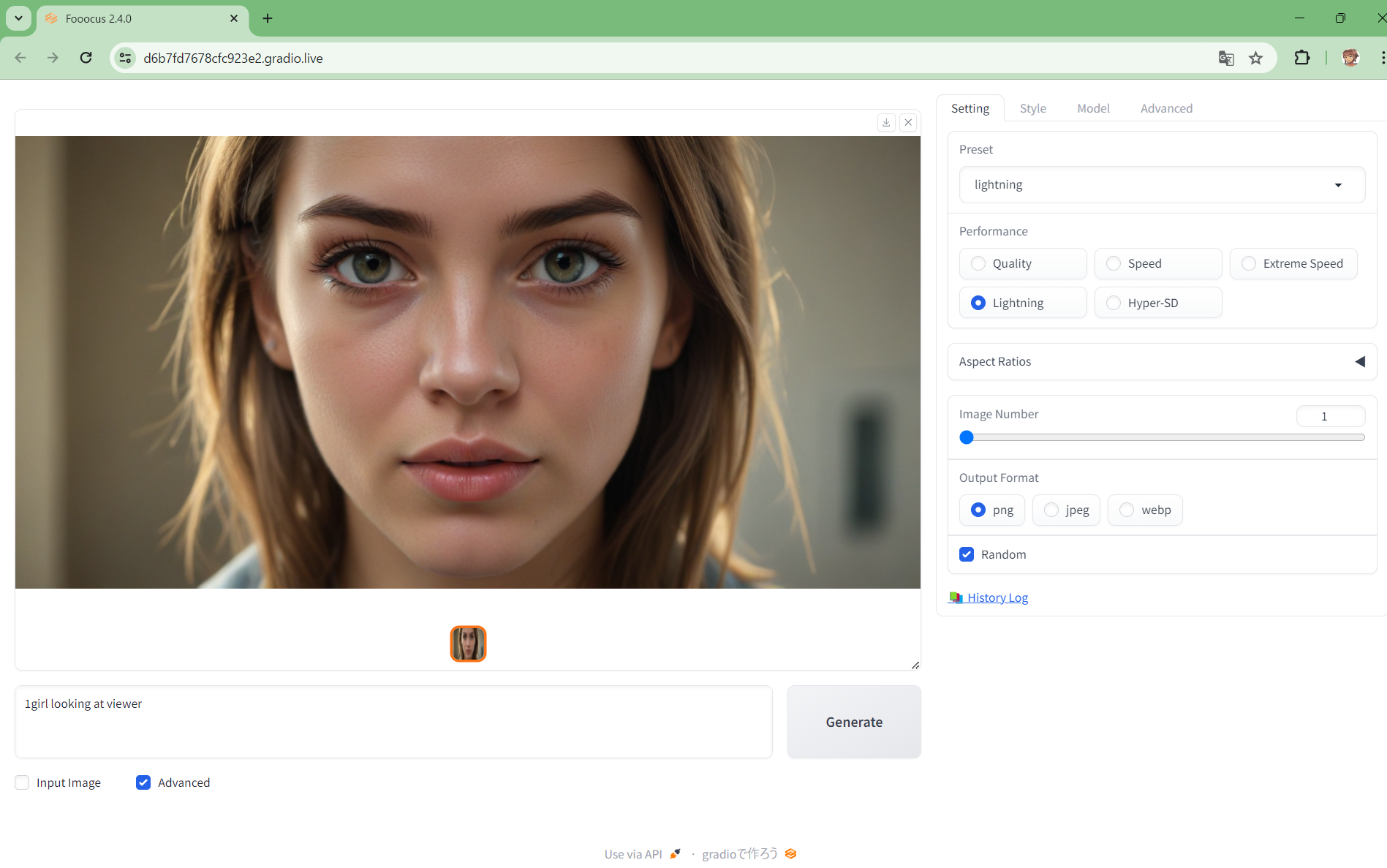

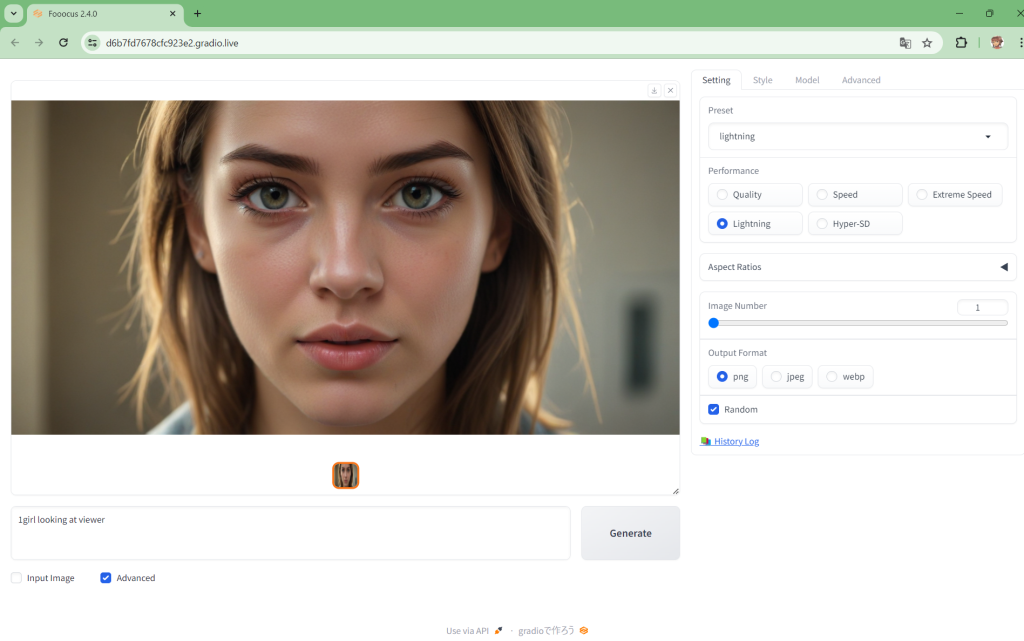

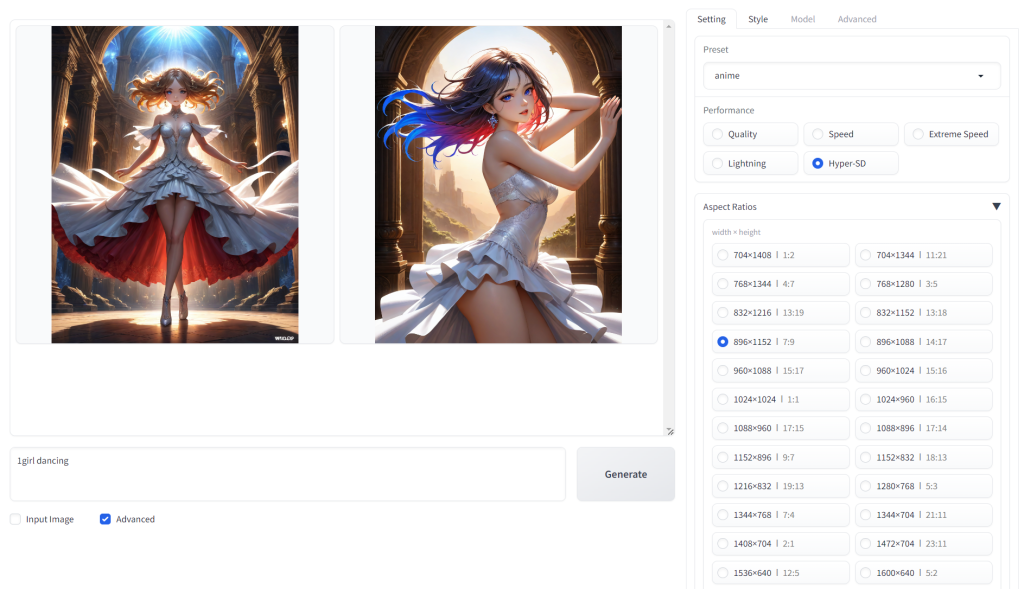

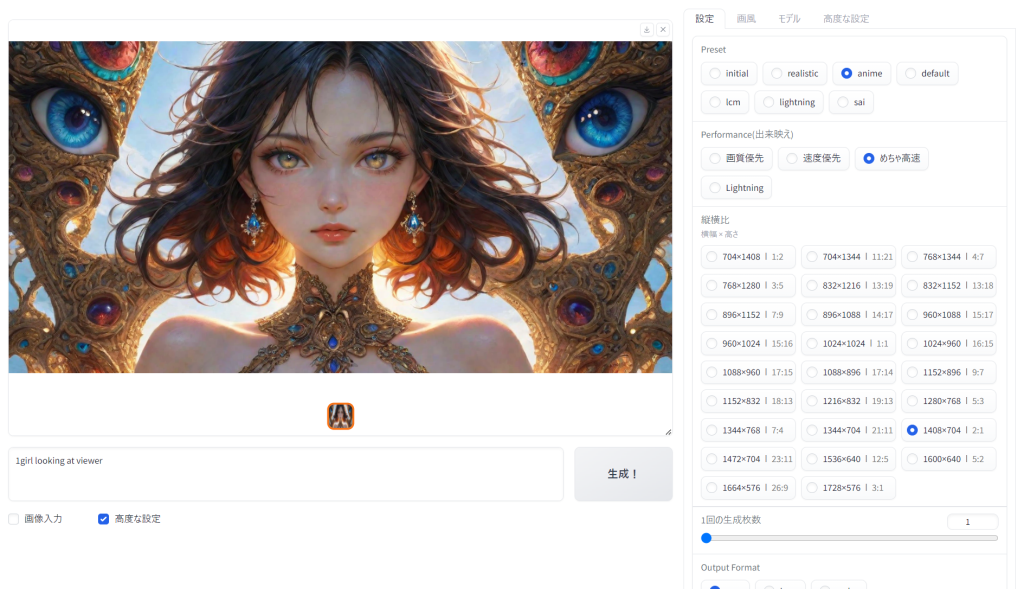

画像生成AIの1つであるStable Diffusionを導入・体験するための入門書です。

プログラミングが分からない、ネットの情報を見てもうまく使えなかった、そんな悩みを抱えている人でもAIを使った画像生成体験ができるようにしっかりサポートします。

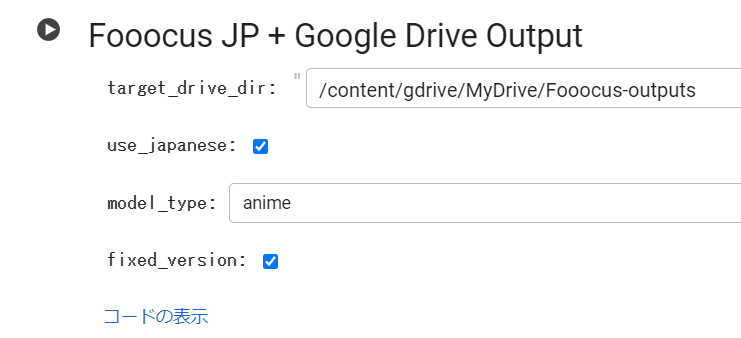

本書籍では以下の環境で解説します。

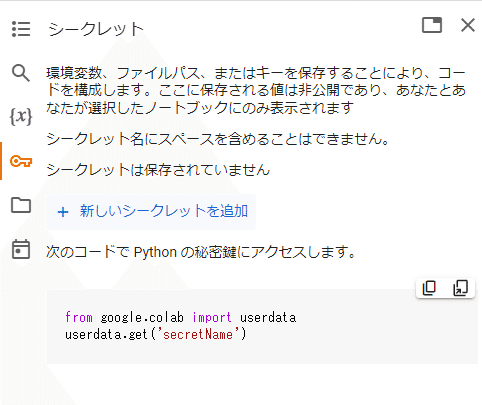

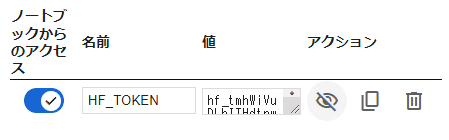

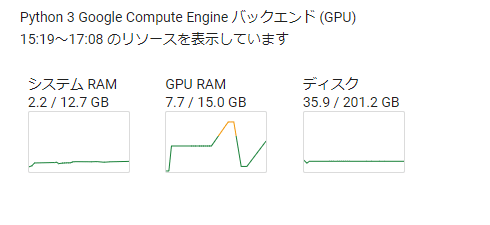

・Google Colab Pro環境

・Windows10/11 NVIDIA GPU環境

・MacOS Apple silicon 環境

本書籍では以下の内容を取り扱います。

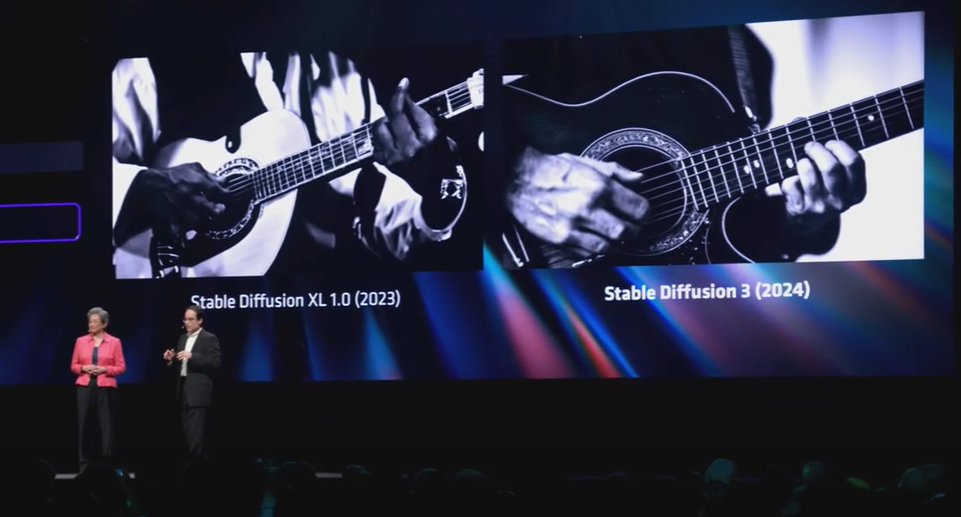

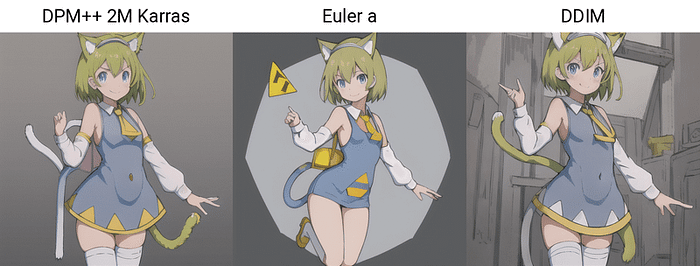

・拡散モデルによる画像生成の原理

・Stable Diffusionを使用するためのWebUI環境構築

・テキスト/画像を元に画像を生成する(txt2img/img2img/ControlNet)

・Google Colab 上で追加学習を行う(LoRAの作成)

本書ではソフトウェアの使い方解説だけではなく、自分で設定できるセッティングやパラメータが画像生成にどのように関わっているのかについても解説しているため、AI技術について知識を深めたい人にとってもおすすめです。

また、既にAIを活用している方にもご満足いただけるように、よりAI画像制作を極めるヒントとなるようなStable Diffusionを含むAI画像生成を利用した作例のメイキング方法やプロンプト構成/生成パラメーターなどの情報を公開・解説しています。ハンズオン形式で最後まで取り組むことで、画像生成AIへの理解をより深めることができる1冊となっています。

Chapter1 画像生成AIについて知ろう

Chapter2 環境構築をしてはじめよう

Chapter3 プロンプトから画像を生成してみよう

Chapter4 画像を使って画像を生成してみよう

Chapter5 ControlNetを使ってみよう

Chapter6 LoRAを作って使ってみよう

Chapter7 画像生成AIをもっと活用しよう

お申し込みはTechplayから

https://techplay.jp/event/946209

各分野に向けた各章を深く掘り下げる形のレギュラーイベントとして実施する可能性がありますので、こちらのコミュニティをフォローよろしくお願いいたします。

https://techplay.jp/community/AICU

また内容も、映像プロフェッショナルから、企業研修、学校団体(クラブ・サークル等含む)も多様に開発していく予定です。

注意事項

- 本ワークショップの配布物や上映内容の録音、スクリーンショットはご遠慮ください。

※公式イベントレポートは AICU media noteメンバーシップにて募集中しております。 - リクルーティング、勧誘など、採用目的でのイベント参加はお断りしております。

- キャンセル待ち・補欠・落選の方はご参加いただくことが出来ませんのでご了承ください。

- 欠席される場合は、お手数ですが速やかにキャンセル処理をお願い致します。

- 無断キャンセルや欠席が続く場合、次回以降の参加をお断りさせていただく場合がございます。